Empieza hoy: Simulacros ICFES Saber 11 con precio especial por tiempo limitado!

Curso de Apache Hadoop

El precio original era: $ 179.419.$ 100.835El precio actual es: $ 100.835.

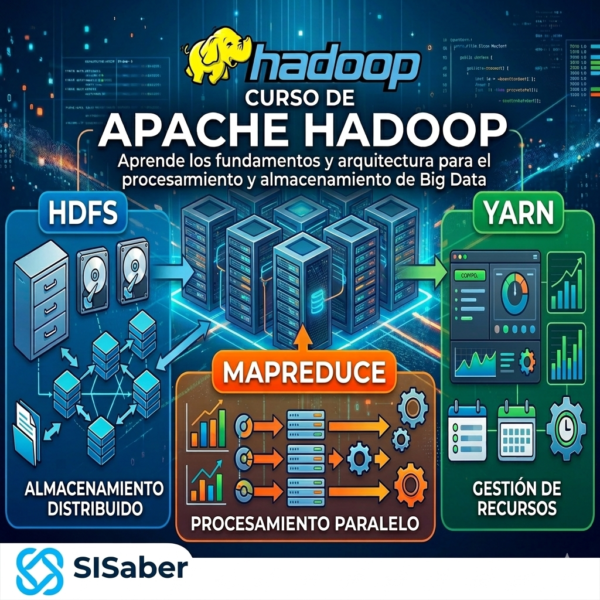

Aprende los fundamentos de Apache Hadoop, una de las tecnologías más importantes para el procesamiento y almacenamiento de Big Data. En este curso conocerás su arquitectura y comprenderás cómo funciona el ecosistema Hadoop para gestionar grandes volúmenes de datos de forma distribuida. Explorarás sus componentes principales: HDFS para almacenamiento distribuido, MapReduce para procesamiento paralelo y YARN para la gestión de recursos del sistema. Ideal para quienes desean iniciarse en el procesamiento de datos a gran escala y tecnologías Big Data.

Aprende Apache Hadoop y descubre cómo procesar grandes volúmenes de datos en arquitecturas distribuidas

El crecimiento exponencial de los datos ha impulsado el desarrollo de tecnologías capaces de almacenarlos y procesarlos de forma eficiente. Apache Hadoop se ha convertido en una de las plataformas más importantes para el procesamiento de grandes volúmenes de información en entornos distribuidos.

En este curso comprenderás los fundamentos de Hadoop, su arquitectura y los componentes que lo conforman. Además, realizarás una práctica guiada donde desplegarás tu propio entorno Hadoop y ejecutarás una aplicación real de procesamiento de datos.

¿Qué aprenderás en este curso?

- Comprender qué es Apache Hadoop y por qué es clave en el ecosistema Big Data.

- Entender cómo funciona HDFS, el sistema de almacenamiento distribuido.

- Aprender el modelo MapReduce para procesamiento paralelo de datos.

- Descubrir cómo YARN administra recursos y coordina el procesamiento.

- Desplegar un entorno Hadoop funcional utilizando Docker.

- Ejecutar la aplicación clásica WordCount para procesamiento distribuido.

Contenido del curso

Unidad 1 — Introducción a Apache Hadoop

Duración: 25 minutos

- ¿Qué es Apache Hadoop?

- Orígenes y etimología del proyecto

- Contexto histórico y evolución de los datos

Unidad 2 — HDFS: Hadoop Distributed File System

Duración: 20 minutos

- ¿Qué es HDFS?

- Arquitectura del sistema de archivos distribuido

- Fragmentación de datos

- Tolerancia a fallos y redundancia

Unidad 3 — MapReduce: El Motor de Procesamiento Distribuido

Duración: 25 minutos

- ¿Qué es MapReduce?

- Fases del modelo MapReduce

- Analogía con la compresión de medios para entender el procesamiento distribuido

Unidad 4 — YARN: Yet Another Resource Negotiator

Duración: 20 minutos

- ¿Qué es YARN?

- Roles y funcionamiento dentro de Hadoop

- Dinámica de trabajo: petición y gestión de recursos

Unidad 5 — Práctica: Instalación y despliegue de Apache Hadoop

Duración: 80 minutos

- Diagrama de arquitectura de un cluster Hadoop

- Descargar plantilla de configuración

- Despliegue de Hadoop utilizando Docker

- Verificación del despliegue

- Validación del funcionamiento del cluster

- Ejecución de la aplicación WordCount

¿Para quién es este curso?

- Estudiantes de ingeniería, informática o ciencia de datos.

- Profesionales interesados en tecnologías Big Data.

- Desarrolladores que desean comprender arquitecturas distribuidas.

- Personas que desean iniciarse en el ecosistema Hadoop.

Duración total del curso

3.0 horas de contenido que combinan teoría y práctica para comprender el funcionamiento real de Apache Hadoop.

Aprende cómo funcionan las plataformas Big Data y da tus primeros pasos en el ecosistema Hadoop.

Solo los usuarios registrados que hayan comprado este producto pueden hacer una valoración.

Valoraciones

No hay valoraciones aún.