Empieza hoy: Simulacros ICFES Saber 11 con precio especial por tiempo limitado!

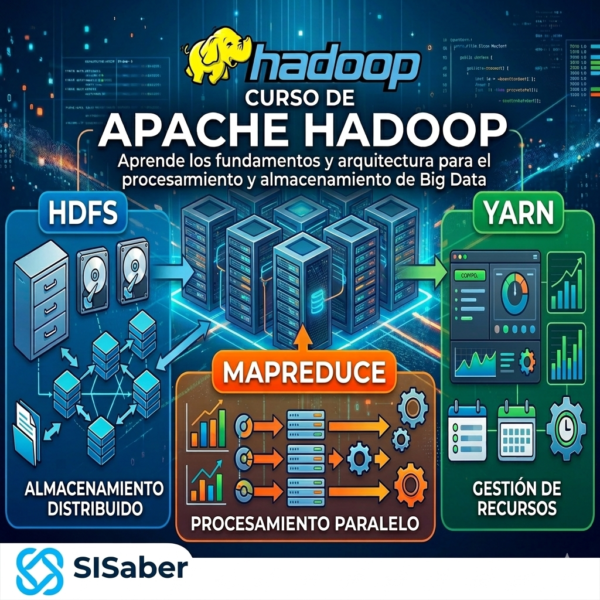

Apache Hadoop desde Cero: HDFS, MapReduce y YARN

El precio original era: $ 181.543.$ 91.277El precio actual es: $ 91.277.

Aprende los fundamentos de Apache Hadoop, una de las tecnologías más importantes para el procesamiento y almacenamiento de Big Data. En este curso conocerás su arquitectura y comprenderás cómo funciona el ecosistema Hadoop para gestionar grandes volúmenes de datos de forma distribuida. Explorarás sus componentes principales: HDFS para almacenamiento distribuido, MapReduce para procesamiento paralelo y YARN para la gestión de recursos del sistema. Ideal para quienes desean iniciarse en el procesamiento de datos a gran escala y tecnologías Big Data. Acceso ilimitado + actualizaciones incluidas. Obtén el curso y recibe todas las mejoras y nuevos contenidos que se publiquen en el futuro. Incluye certificado de aprobación del curso.

Aprende Apache Hadoop y descubre cómo procesar grandes volúmenes de datos en arquitecturas distribuidas

El crecimiento exponencial de los datos ha impulsado el desarrollo de tecnologías capaces de almacenarlos y procesarlos de forma eficiente. Apache Hadoop se ha convertido en una de las plataformas más importantes para el procesamiento de grandes volúmenes de información en entornos distribuidos.

En este curso comprenderás los fundamentos de Hadoop, su arquitectura y los componentes que lo conforman. Además, realizarás una práctica guiada donde desplegarás tu propio entorno Hadoop y ejecutarás una aplicación real de procesamiento de datos.

¿Qué aprenderás en este curso?

- Comprender qué es Apache Hadoop y por qué es clave en el ecosistema Big Data.

- Entender cómo funciona HDFS, el sistema de almacenamiento distribuido.

- Aprender el modelo MapReduce para procesamiento paralelo de datos.

- Descubrir cómo YARN administra recursos y coordina el procesamiento.

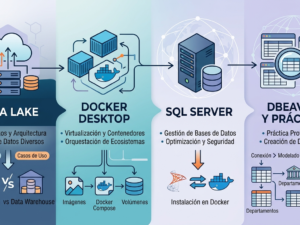

- Desplegar un entorno Hadoop funcional utilizando Docker.

- Ejecutar la aplicación clásica WordCount para procesamiento distribuido.

Contenido del curso

Unidad 1 — Introducción a Apache Hadoop

Duración: 25 minutos

- ¿Qué es Apache Hadoop?

- Orígenes y etimología del proyecto

- Contexto histórico y evolución de los datos

Unidad 2 — HDFS: Hadoop Distributed File System

Duración: 20 minutos

- ¿Qué es HDFS?

- Arquitectura del sistema de archivos distribuido

- Fragmentación de datos

- Tolerancia a fallos y redundancia

Unidad 3 — MapReduce: El Motor de Procesamiento Distribuido

Duración: 25 minutos

- ¿Qué es MapReduce?

- Fases del modelo MapReduce

- Analogía con la compresión de medios para entender el procesamiento distribuido

Unidad 4 — YARN: Yet Another Resource Negotiator

Duración: 20 minutos

- ¿Qué es YARN?

- Roles y funcionamiento dentro de Hadoop

- Dinámica de trabajo: petición y gestión de recursos

Unidad 5 — Práctica: Instalación y despliegue de Apache Hadoop

Duración: 80 minutos

- Diagrama de arquitectura de un cluster Hadoop

- Descargar plantilla de configuración

- Despliegue de Hadoop utilizando Docker

- Verificación del despliegue

- Validación del funcionamiento del cluster

- Ejecución de la aplicación WordCount

¿Para quién es este curso?

- Estudiantes de ingeniería, informática o ciencia de datos.

- Profesionales interesados en tecnologías Big Data.

- Desarrolladores que desean comprender arquitecturas distribuidas.

- Personas que desean iniciarse en el ecosistema Hadoop.

Duración total del curso

3.0 horas de contenido que combinan teoría y práctica para comprender el funcionamiento real de Apache Hadoop.

Aprende cómo funcionan las plataformas Big Data y da tus primeros pasos en el ecosistema Hadoop.

Acceso ILIMITADO al curso, con todas las futuras actualizaciones incluidas para que siempre cuentes con contenido vigente y en constante mejora.

| Certificado al finalizar | Sí |

|---|

16 valoraciones en Apache Hadoop desde Cero: HDFS, MapReduce y YARN

Solo los usuarios registrados que hayan comprado este producto pueden hacer una valoración.

Nicolás Eduardo Anzola Pedraza (verificado) –

El curso de Apache Hadoop es bastante práctico, además que ofrece un gran panorama sobre lo que en sí significa Big data y lo importante que es en el diario vivir, sobretodo en aquellos que trabajan en datos.

Uno de los aspectos más valiosos del curso es el enfoque práctico, ya que se realizan ejercicios donde se configura un entorno de trabajo utilizando herramientas como Docker, permitiendo desplegar un cluster de Hadoop y trabajar con datos distribuidos con cualquier dataset.

En general, es un curso muy útil para quienes desean iniciar en el área de Big Data y procesamiento distribuido, combina de buena forma la teoría con la práctica. Totalmente recomendado!

Juan de Jesús Cárdenas Pérez (verificado) –

El curso de Apache Hadoop me pareció muy interesante y útil para comprender cómo se manejan grandes volúmenes de datos en entornos de Big Data. Durante el curso aprendí conceptos importantes sobre el ecosistema de Hadoop, el almacenamiento distribuido y el procesamiento de datos a gran escala. Me gustó especialmente conocer herramientas como Hadoop, Hive y Spark fue un curso muy enriquecedor que aporta bases importantes para quienes desean profundizar en el mundo del Big Data

Leslianye Pulido Díaz (verificado) –

El curso de Apache Hadoop me permitió comprender los conceptos fundamentales relacionados con el procesamiento y almacenamiento de grandes volúmenes de datos mediante arquitecturas distribuidas. A lo largo del curso se abordaron aspectos clave del ecosistema Hadoop, lo que facilitó una mejor comprensión de las herramientas utilizadas en entornos de Big Data.

Este curso aporta herramientas relevantes para la comprensión y uso de tecnologías orientadas al procesamiento y análisis de grandes volúmenes de datos.

Jorge Alexander Velasco Lopez (verificado) –

Excelente introducción a los pilares del procesamiento distribuido. El curso no solo explica el ‘qué’ es Hadoop, sino el ‘cómo’ funciona su tolerancia a fallos y la gestión de recursos. Es una guía práctica fundamental para comprender el cambio de paradigma que supone procesar información en paralelo, convirtiéndose en un recurso clave para desarrolladores y científicos de datos.

Carlos Eduardo Rodriguez Lopez (verificado) –

El curso nos ofrece gran apertura de conocimientos para realizar conexión con grandes volúmenes de datos, muy práctico para saber cómo podemos realizar procesos con las aplicaciones y poder escribir código que nos permita comprender de manera clara el funcionamiento del HDFS, YARN Y MAPREDUCE.

Este curso también me ayudó a familiarizarme mejor con los contenedores de Docker y tener un aprendizaje muy práctico.

Sandra Milena Castellanos Cañon (verificado) –

El curso de Apache Hadoop ofreció una introducción bastante completa al mundo del Big Data y al procesamiento de datos distribuidos. A lo largo de las actividades se pudieron comprender conceptos fundamentales relacionados con el almacenamiento y análisis de información a gran escala, además de conocer diferentes herramientas que hacen parte del ecosistema Hadoop.

Uno de los puntos más destacados fue la posibilidad de realizar prácticas que permitieron interactuar directamente con los entornos de trabajo y entender mejor el funcionamiento de tecnologías utilizadas actualmente en el área de datos. Gracias a esto, el aprendizaje se volvió más dinámico y fácil de aplicar en situaciones reales.Es un curso que brinda bases sólidas para continuar profundizando en temas de analítica y manejo de datos masivos, siendo una muy buena alternativa para quienes desean ampliar sus conocimientos en tecnologías de Big Data.

Edgar Daniel Torres Quevedo (verificado) –

Este curso me ayudó a fortalecer mi visión sobre análisis de datos y arquitectura de información, ya que Hadoop no solo se enfoca en almacenar datos, sino en convertirlos en información útil para la toma de decisiones. Aunque al inicio algunos conceptos técnicos parecían complejos, la práctica permitió comprender mejor la lógica de funcionamiento del ecosistema Hadoop. Además de que, considero que fue una experiencia muy útil porque amplía las oportunidades profesionales en áreas relacionadas con Big Data, analítica y transformación digital, que actualmente tienen mucha demanda en el mercado laboral a nivel global. Gracias!

Liseth Johana Bonilla ujueta (verificado) –

Un buen curso, muy práctico me permitió comprender mejor los conceptos relacionados con Hadoop y procesamiento distribuido.

Ana Maria Quintero Garcia (verificado) –

El curso me pareció muy completo y útil para comprender el manejo de grandes volúmenes de datos en entornos empresariales, la metodología fue clara y permitió entender tanto la parte teórica como la práctica, este curso aporta conocimientos importantes para aplicarlos en proyectos reales y en el ámbito laboral.

Angia Milena García Peñuela (verificado) –

Me pareció un curso genial, tiene un enfoque práctico para configurar y entender cómo interactúa el ecosistema de Hadoop. El instructor logra que conceptos complejos de infraestructura y tolerancia a fallos sean muy fáciles de digerir. El material ayuda muchísimo a consolidar el aprendizaje teórico practico 😉

Maria Paula Torres Jimenez (verificado) –

El curso de Apache Hadoop me pareció muy interesante y enriquecedor, ya que permitió comprender conceptos fundamentales relacionados con Big Data, almacenamiento distribuido y procesamiento de datos a gran escala.

Uno de los aspectos que más destaco es el enfoque práctico del curso, porque las actividades y ejercicios facilitaron entender mejor el funcionamiento del ecosistema Hadoop y herramientas utilizadas actualmente en el área de datos. Además, la metodología fue clara y dinámica, haciendo más sencillo aprender temas técnicos.

En general, es un curso muy útil para quienes desean fortalecer conocimientos en tecnologías de Big Data y ampliar sus habilidades en el análisis y manejo de grandes volúmenes de información. Totalmente recomendado.

Cristian David Rodriguez Noguera (verificado) –

El curso me parece interesante, detallado y practico, al momento de realizar el despliegue de estas herramientas.

Adicionalmente, sus ejemplos prácticos en las herramientas ayudan a que el aprendizaje sea mas ameno, con el cuestionario teórico.

Muy recomendable!

Maria Fernanda Cruz Gavilan (verificado) –

Fue una experiencia muy útil para aprender sobre Big Data y procesamiento de datos a gran escala. Los temas fueron claros y prácticos, especialmente el uso de HDFS y MapReduce. Además, las actividades me ayudaron a comprender mejor cómo se gestionan grandes volúmenes de información en entornos reales.

Marcela Arcila Chiquiza (verificado) –

Ha sido una experiencia altamente enriquecedora, especialmente para comprender cómo las organizaciones pueden gestionar grandes volúmenes de información de manera eficiente y estratégica. No solo aporta conocimientos técnicos, sino que amplía la visión sobre el rol de los datos en la transformación digital.

John Alexander Ramirez Bernal (verificado) –

La clase de Apache Hadoop me gustó mucho porque permitió comprender cómo funciona el almacenamiento y procesamiento de grandes volúmenes de datos de una manera práctica y organizada. Fue interesante conocer herramientas y conceptos fundamentales de Big Data, además de entender su importancia en el entorno tecnológico actual. La explicación fue clara y dinámica, lo que hizo que el aprendizaje fuera más fácil y entretenido.

Cristian David Rodriguez Noguera (verificado) –

El curso es una excelente introducción a los sistemas distribuidos, la manera en como se explica el funcionamiento de un maestro y sus esclavos, al momento de distribuir la carga de trabajo.

La practica de instalación es interactiva y la guía en el paso a paso, es fácil de entender